自1970年代诞生以来,鼠标指针几乎没有进化过。它出现在每一个网站、每一份文档、每一套工作流程里,却从未真正理解过你在做什么。近日,Google DeepMind发布研究博客,展示由Gemini驱动的实验性原型「AI-enabled pointer」,并在Google AI Studio开放两个实验Demo。

一、MagicPointer:让鼠标指针真正"看懂"你在做什么

这个由DeepMind团队打造的功能名为MagicPointer(魔法指针),其核心突破在于:AI不再只是被动等待指令,而是通过鼠标指针的位置,主动理解用户正在关注的内容与意图。当你将指针指向屏幕上的某一区域,AI便能识别指针所指向的对象——无论是一张图片、一段文字,还是一个数据表格,并据此提供相应的智能辅助。

与传统交互方式不同,MagicPointer不需要用户停下来、切换窗口、输入冗长的提示词。AI能力直接嵌入用户当前使用的工具和页面中,保持工作流的连续性。例如,用户只需将指针指向一栋建筑的图片,并说一句"帮我查路线",AI系统便能自动理解上下文,无需任何额外说明。

二、四大核心原则:重新定义人机交互逻辑

DeepMind团队在介绍MagicPointer时,提出了四大核心设计原则,勾勒出下一代人机交互的雏形。

第一是保持工作流。AI能力覆盖各类应用场景,例如指向PDF生成摘要、悬停表格自动生成饼图,整个过程无需离开当前页面。第二是边指边说。系统能够捕捉指针周围的视觉与语义信息,精确理解用户的操作意图,将"指着说"变成最自然的交互方式。

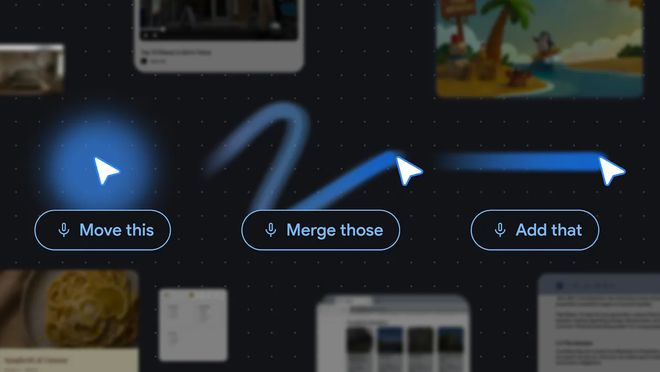

第三是自然表达。支持"这个"、"那个"等自然手势和口语化指令,用户无需组织完整的长句,AI便能心领神会。第四是像素转实体。系统将屏幕上的像素转化为可操作的实体——地点、日期、任务等,例如将一张便签直接转化为交互式待办清单,或将视频中的餐厅画面对应为预订链接。

三、从实验室到桌面:MagicPointer的落地路径

目前,MagicPointer的功能演示已经在Google AI Studio上线,任何人都可访问并体验这一实验性原型。DeepMind表示,该技术将逐步引入Chrome浏览器中的Gemini,用户未来可直接围绕网页内容进行提问和操作,无需安装额外插件或切换应用。

这一功能的意义远不止于"炫技"。它标志着AI交互从"对话式"向"融入式"的根本性转变。过去几年,AI助手大多停留在对话框里,用户需要主动去"找AI";而MagicPointer的方向是让AI"找到你"——在你工作的每一个角落,悄无声息地提供恰到好处的帮助。

谷歌DeepMind的这一尝试,也为整个行业提供了一个重要参考:当大模型能力趋于同质化,交互方式的创新将成为下一阶段竞争的关键战场。那个陪了你50年的鼠标指针,也许真的要长出大脑了。