近日,阿里巴巴通义实验室推出了一种名为 ZeroSearch 的强化学习框架,该框架能够在无需与真实搜索引擎交互的情况下,显著提升大型语言模型(LLM)的搜索能力。这一创新技术不仅解决了传统方法中搜索引擎返回文档质量不可控和 API 成本过高的问题,还通过轻量级监督微调和课程学习机制,逐步提升模型的推理能力,展现了强大的扩展性和通用性。论文地址:https://arxiv.org/pdf/2505.04588

一、ZeroSearch框架的核心技术

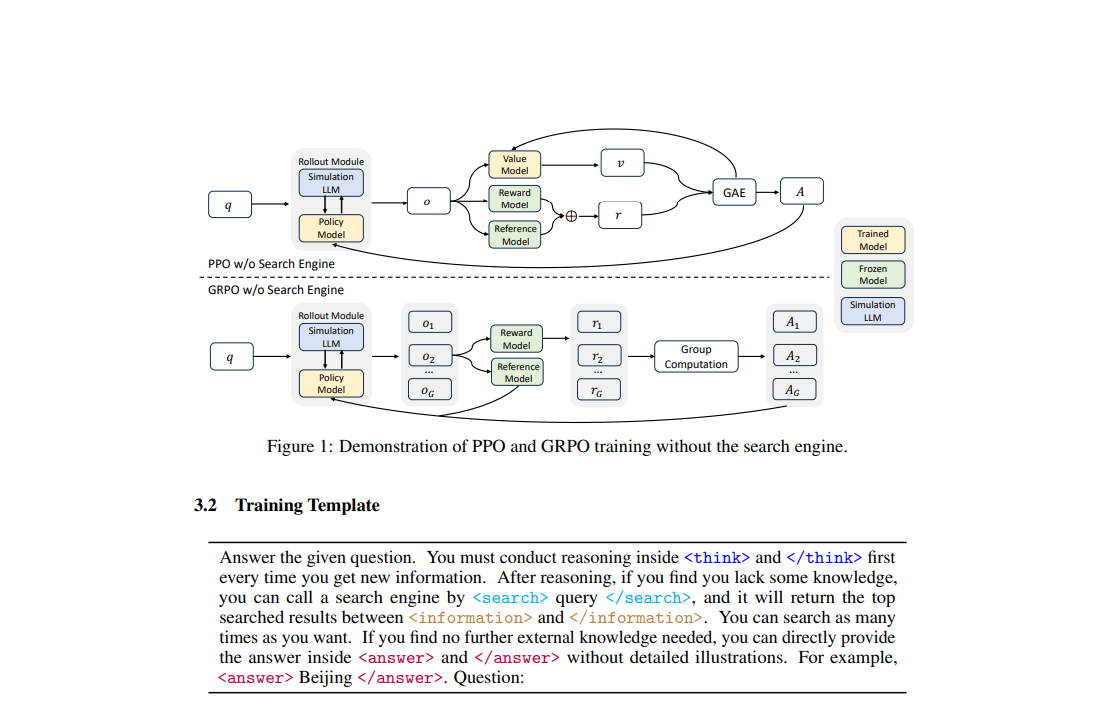

ZeroSearch框架的核心在于将大型语言模型转化为一个检索模块,使其能够根据查询生成相关或噪声文档。通过轻量级监督微调,模型能够动态控制文档质量,支持生成相关或噪声文档,为训练提供多样化检索场景。此外,ZeroSearch采用课程学习机制,在训练中逐步增加文档噪声水平,让模型从简单场景开始,逐步适应更具挑战性的任务,从而提升推理能力。

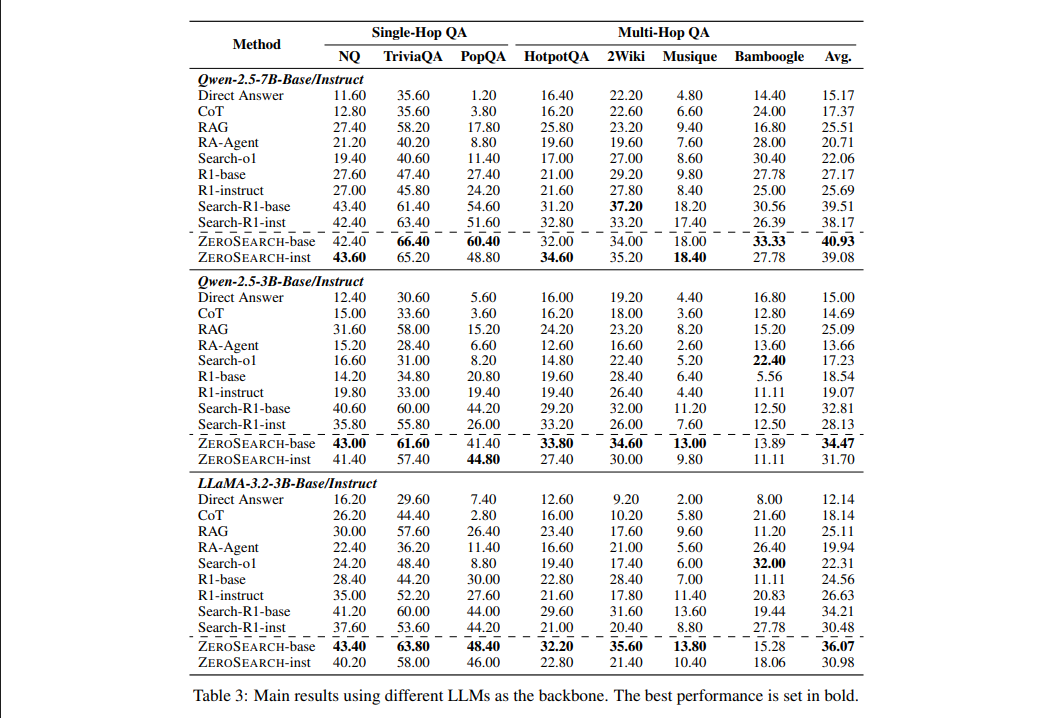

二、实验结果与性能表现

在多个问答数据集上的测试显示,ZeroSearch的性能超过了谷歌搜索,并且大幅降低了训练成本。具体来说,使用 3B 参数规模的模型作为检索模块时即可激发语言模型检索能力,7B 模型的检索性能已接近真实搜索引擎,而 14B 模型甚至实现了超越。此外,ZeroSearch对基础模型和指令微调模型均具有良好的泛化能力,并可兼容多种强化学习算法,展现出强大的适应性与可扩展性。

三、应用前景与潜在影响

ZeroSearch的出现将拓展信息检索的边界,使其不再局限于传统搜索引擎的索引和关键词匹配方式。它能够更深入地理解用户需求,提供更精准、更个性化的搜索结果。这将推动信息检索技术的发展,为用户提供更多创新应用场景。同时,ZeroSearch的开源为许多企业尤其是初创公司提供了强大的工具,大幅降低了搜索引擎的开发与维护成本。

四、局限性与挑战

尽管ZeroSearch具有诸多优势和应用前景,但也存在一些局限性和挑战。例如,部署模拟搜索的大型语言模型需要访问 GPU 服务器,这会带来额外的基础设施成本。此外,ZeroSearch的性能在很大程度上取决于模拟环境的真实性。如果模拟环境与真实环境存在较大差异,则可能导致模型在实际应用中的性能下降。

五、总结与展望

ZeroSearch作为一种创新的强化学习框架,成功解决了大语言模型搜索能力训练中的难题,为未来的人工智能领域提供了新的思路和方法。随着技术的不断发展,我们有理由相信,ZeroSearch将在智能客服、知识图谱构建、智能写作和教育等领域发挥更大的作用,推动大语言模型技术的进一步发展。